Matthias Spielkamp: Der Algorithmus-Wächter

Je komplexer Algorithmen werden, desto weniger können wir die Ergebnisse nachvollziehen. Matthias Spielkamp, Geschäftsführer von AlgorithmWatch, sieht darin eine Gefahr für unsere Demokratie – und stellt Forderungen.

Wenn man Matthias Spielkamp bittet, einen Algorithmus zu erklären, dann geht er viele Jahre zurück: „Was ein Algorithmus ist, das habe ich eigentlich schon in der Grundschule gelernt. Denn im Grunde macht ein Algorithmus auch nichts anderes als das, was wir unter schriftlichem Subtrahieren oder Addieren kennen. Nur mit sehr großen Datenmengen.“ Ein Algorithmus ist nicht einfach so da, ein Algorithmus wird programmiert. Menschen sagen dem Algorithmus, meist sind es mehrere Algorithmen, wie Daten ausgewertet werden sollen und was dann mit dem Ergebnis passiert. „Das entscheidet die Technologie nie selbst. Ein Algorithmus hat keine Absicht, keine Autonomie und keinen freien Willen.“ Matthias Spielkamp ist weder Informatiker noch Coder, er hat nicht Mathematik studiert. Matthias Spielkamp ist Journalist. „Dadurch habe ich sehr früh angefangen, im Netz zu recherchieren. Und dafür habe ich Internetsuchmaschinen genutzt.“

Der Algorithmus entscheidet, was relevant ist

1997 haben zwei Doktoranden der Stanford University an einem neuen Projekt geforscht, das unser aller Leben heute maßgeblich beeinflusst: Google. Die Suchmaschine hat für die damalige Zeit ein einmaliges Verfahren dafür genutzt, mit ihrem Sortieralgorithmus die Suchergebnisse zu ranken, also nach Relevanz zu ordnen. Und was relevant ist, bestimmt ein programmierter Algorithmus. Er entscheidet, welche Ergebnisse auf Seite eins, zwei oder vier angezeigt werden. Plötzlich war das Wort „Algorithmus“ für Matthias Spielkamp ganz eng mit einer Funktion verknüpft.

Google ist auch heute nicht die einzige Suchmaschine, aber sie ist die mit dem höchsten Marktanteil – und zwar mit Abstand. 80 Prozent der Menschen, die im Januar 2022 an ihren Desktop-Computern etwas suchten, nutzten Google. „Die Tatsache, dass wir hauptsächlich diese eine Suchmaschine verwenden, um uns zu informieren, ist überhaupt nicht unproblematisch. Damit erschließen wir uns auch unsere Welt“, sagt Matthias Spielkamp. Schon damals, kurz bevor das neue Millennium begann, hat er verstanden: „Das spielt eine gesellschaftliche Rolle.“

Ein wissenschaftliches Paper mit Folgen

Ein Zeitsprung. Im Jahr 2015 liest Matthias Spielkamp ein Paper des Wissenschaftlers Nicholas Diakopoulos. Darin wird die Frage gestellt, wie wir als Gesellschaft Klarheit darüber erlangen können, welche Macht Algorithmen auf uns individuell und als Kollektiv ausüben. „Diakopoulos ist der Ansicht, dass es die Aufgabe von Journalist*innen sei, das zu beobachten und zu hinterfragen.“

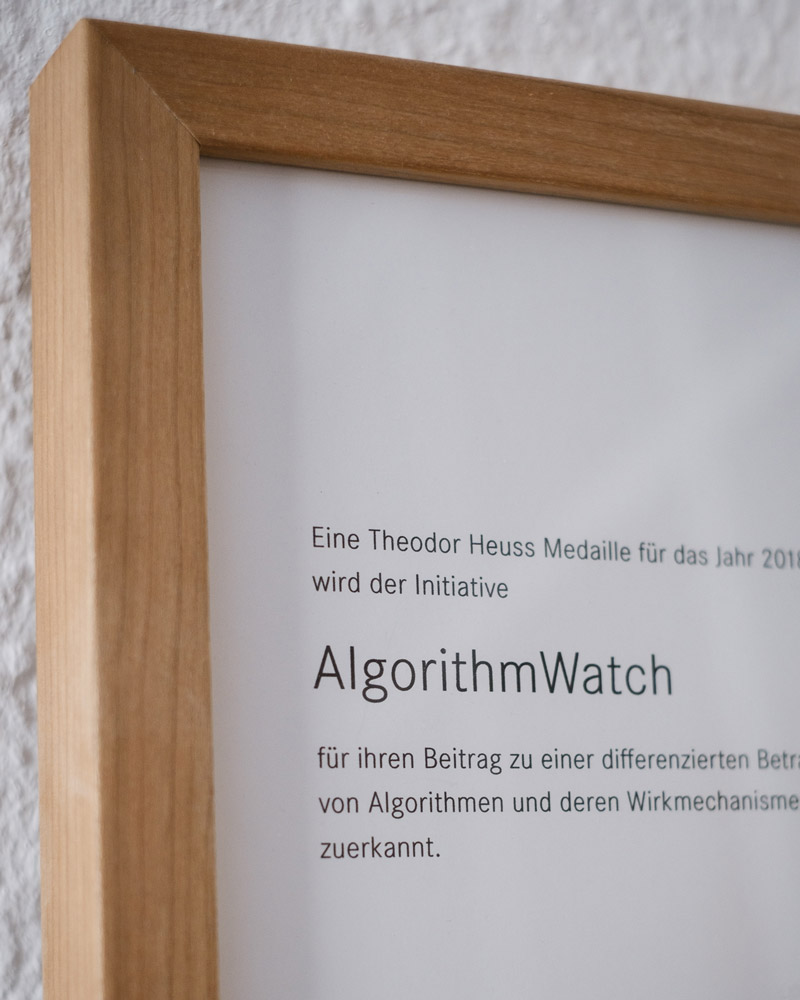

Und dann ist sie da, die Verbindung. „Meine Technikliebe, mein Technikverständnis und meine journalistische und politische Ader – alle mir wichtigen Themen sind hier zusammengekommen“, sagt er. Also gründet er 2015 gemeinsam mit Lorena Jaume-Palasí, Lorenz Matzat und Katharina Anna Zweig die gemeinnützige Initiative AlgorithmWatch.

„Technische Systeme dürfen die Menschenrechte nicht beschädigen“

Die Initiative hat ein klares Ziel: Sie will Prozesse der algorithmischen Entscheidungsfindung, die eine gesellschaftliche Relevanz haben, betrachten und einordnen. Damit sind Prozesse und Systeme gemeint, die menschliche Entscheidungen vorhersagen oder vorbestimmen oder die ganz automatisiert diese Entscheidungen treffen. „Diese Systeme sollen genutzt werden, wenn sie einen Nutzen bringen. Wir fordern aber auch: Sie dürfen uns als Gesellschaft und unsere individuellen Menschenrechte nicht beschädigen“, sagt Matthias Spielkamp.

Denn algorithmische Systeme, die automatisiert Entscheidungen treffen, werden nicht nur dafür eingesetzt, Suchergebnisse zu sortieren. Sie beeinflussen auch, ob wir einen Kredit bekommen und zu welchem Zinssatz. Sie unterstützen Personalabteilungen bei der Auswahl von Bewerber*innen. Sie spülen uns kuratierte Nachrichten in unsere Social-Media-Feeds, schön in die eigene Echo-Kammer hinein. Und sie bestimmen, an welchen Orten die Polizei häufiger patrouilliert. Insbesondere bei Systemen, die bei Behörden und im öffentlichen Sektor eingesetzt werden, gilt Vorsicht: „Wir müssen darauf vertrauen können, dass diese Verfahren unsere Rechte achten. Denn wir können uns diesen Prozessen nicht entziehen.“ Auch deswegen findet Matthias Spielkamp die Rolle von AlgorithmWatch als Wächterin über solche Entwicklungen wichtig.

„Ein Algorithmus diskriminiert nicht. Er wird verwendet, um zu diskriminieren“

Denn wie ein Algorithmus zu einer Entscheidung kommt, ist nicht immer erklär- und durchschaubar, insbesondere, je komplexer die Systeme werden. Spielkamp spricht von einer Blackbox: Daten werden verwendet, es gibt ein Ergebnis, aber wie das Ergebnis genau zustande kommt, bleibt unklar. Daraus leitet sich eine weitere Forderung von AlgorithmWatch ab: Die Ergebnisse müssen nachvollziehbar sein, sonst besteht eine Gefahr für die Demokratie. Denn durch die automatisierten Entscheidungen können Menschen diskriminiert werden, nicht immer seien die Schlussfolgerungen gerecht und fair. Matthias Spielkamp sieht darin auch eine große gesellschaftliche Verantwortung und fordert, dass diese Verantwortung übernommen wird: „Ein Algorithmus diskriminiert nicht, das kann er gar nicht. Er wird von Menschen verwendet, um zu diskriminieren.“

Algorithmen als Gefahr und als Chance

In all den Diskussionen, die Matthias Spielkamp führt, als Sachverständiger für Anhörungen des Europarats, im EU-Parlament, als Mitglied der Global Partnership on Artificial Intelligence (GPAI), hat er nie das Ziel, die Technik zu verdammen. Auch hier wäre die Suchmaschine wieder ein gutes Beispiel, sagt er: „Wie würden wir uns sonst im Internet zurechtfinden?“ Aber es ginge eben schon darum, einen kritischen Blick zu wagen. Auf Fragen wie diese: Wer kontrolliert unsere Daten? Dürfen Unternehmen Datenmonopole aufbauen? Welche Daten sollen gespeichert werden? Welche Technologien, beispielsweise die biometrische Überwachung, gehören reguliert? „Wir müssen uns immer fragen, ob eine bestimmte Technologie mit unseren demokratischen und rechtsstaatlichen Grundsätzen vereinbar ist“, sagt er. Und: „Deswegen müssen die Hürden sehr hoch liegen. Sonst bekommen wir ein massives Problem.“

AlgorithmWatch hat ein Manifest formuliert. Darin wird gefragt, wie viel unserer Freiheit wir auf algorithmische Entscheidungen übertragen wollen. Weil es darauf keine abschließende Antwort gibt, stellt sich Matthias Spielkamp diese Frage immer wieder neu.

AlgorithmWatch

AlgorithmWatch ist eine gemeinnützige Organisation mit dem Ziel, Prozesse algorithmischer Entscheidungsfindung zu beobachten und einzuordnen. Besonders die, die eine gesellschaftliche Relevanz haben – die also entweder menschliche Entscheidungen vorhersagen, vorbestimmen oder automatisiert treffen.

algorithmwatch.org/de/